Uno de los tres "padrinos de la IA" ha afirmado que la tecnología no dominará el mundo ni eliminará definitivamente los puestos de trabajo.

El profesor Yann LeCun se refirió a las preocupaciones de algunos expertos de que la IA podría poner en peligro a la humanidad como "absurdamente ridículas"."

Dentro de muchos años, los ordenadores superarán a la inteligencia humana, pero añadió que "si te das cuenta de que no es seguro, simplemente no lo construyes".

Según un reciente informe de la BBC, algunas inteligencias artificiales extremadamente potentes podrían tener que ser ilegalizadas.

Por sus innovaciones en IA, el profesor LeCun, Yoshua Bengio y Geoffrey Hinton compartieron el Premio Turing 2018, ganándose el título de "los padrinos de la IA".

En Meta, la empresa matriz de Facebook, Instagram y WhatsApp, el profesor LeCun es actualmente el científico jefe de IA. Sus compañeros padrinos están de acuerdo en que la IA supone una amenaza para la raza humana, pero él no está de acuerdo.

No, dice, "la IA no se apoderará del mundo; se trata simplemente de la proyección de la naturaleza humana sobre las máquinas". Mantener la investigación de la IA "bajo llave" sería un grave error, continuó.

El profesor LeCun argumentó que las personas que expresaron su preocupación por que la IA pudiera ser peligrosa para las personas lo hicieron porque eran incapaces de prever cómo podría hacerse segura.

"Es como preguntar a alguien en 1930 cómo vas a hacer que un turborreactor sea seguro; los turborreactores aún no se habían inventado, igual que la IA a nivel humano aún no se había inventado. "

Lo mismo ocurriría con la IA, predijo. "Los turborreactores acabaron siendo increíblemente fiables y seguros".

Producir máquinas inteligentes con capacidades de nivel humano es uno de los objetivos del amplio programa de investigación en IA de Meta. La empresa emplea la IA además de la investigación para identificar publicaciones dañinas en las redes sociales.

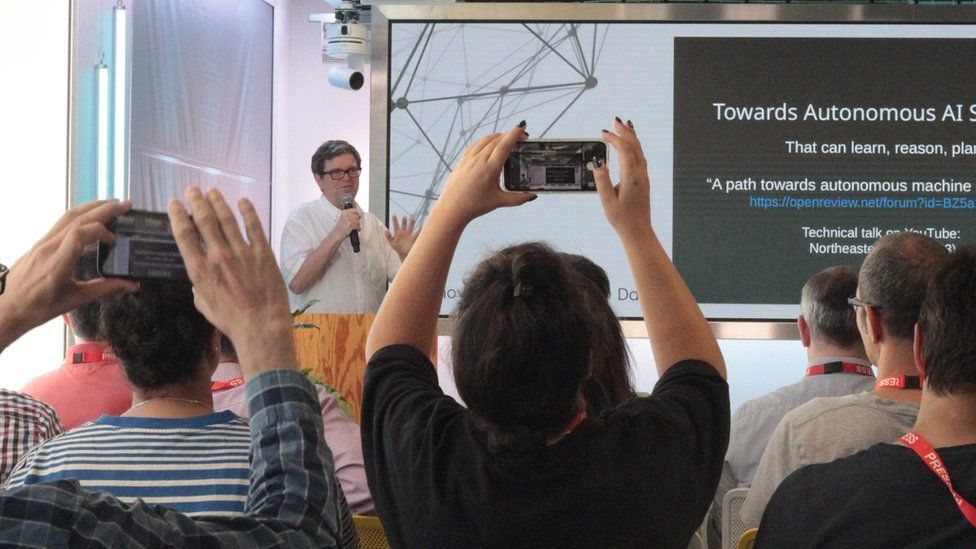

El profesor LeCun habló de su propio trabajo en la llamada IA dirigida por objetivos, que pretende crear sistemas seguros que puedan recordar, razonar, planificar y tener sentido común, características de las que carecen chatbots bien conocidos como ChatGPT. Habló en un acto reservado a los medios de comunicación invitados.

Insistió en que "no cabe duda" de que la IA acabará superando a la inteligencia humana. Sin embargo, los investigadores tardarían años, si no décadas, en completar los conceptos necesarios y alcanzar ese nivel.

Inteligencia general artificial (AGI) es el término que se utiliza cuando la gente expresa su preocupación por futuras máquinas que podrían ser inteligentes al nivel humano o superior. Similares a los humanos, estos sistemas son capaces de resolver una gran variedad de problemas.

A los científicos les preocupaba que, de existir la AGI, fueran capaces de "encender un sistema superinteligente que se apoderara del mundo en cuestión de minutos", dijo. "Eso es absurdamente absurdo. "

En respuesta a una pregunta de BBC News, el profesor LeCun afirmó que se producirían avances graduales y que tal vez algún día podría desarrollarse una IA tan potente como el cerebro de una rata. Argumentó que, puesto que no iba a dominar el mundo, "seguirá funcionando en un centro de datos en algún lugar con un interruptor de apagado". Y simplemente no lo construyes si te das cuenta de que no es seguro, continuó.

Un efecto negativo en el empleo.

Muchos puestos de trabajo podrían ser potencialmente reemplazados por la IA, según algunos argumentos, por lo que algunas empresas han dejado de contratar para puestos específicos.

Esto no dejará a mucha gente sin trabajo de forma permanente, aseguró el profesor LeCun a la BBC. No "tenemos ni idea" de cuáles serán los trabajos más conocidos dentro de 20 años, afirmó, por lo que el trabajo cambiaría.

Según él, los ordenadores inteligentes provocarían "un nuevo renacimiento para la humanidad" del mismo modo que lo hicieron internet o la imprenta.

El discurso del profesor LeCun del martes se produjo antes de una votación sobre la Ley de Inteligencia Artificial para Europa, que pretende regular la inteligencia artificial.

"No les gusta nada, creen que es demasiado amplia, quizá demasiado restrictiva", afirmó, citando sus conversaciones con start-ups de inteligencia artificial en Europa. Sin embargo, afirmó carecer de conocimientos jurídicos.

El profesor LeCun declaró que, aunque no se oponía a la regulación, creía que cada aplicación requeriría su propio conjunto de directrices. Por ejemplo, cree que debería haber directrices diferentes para los sistemas de IA utilizados en automóviles y los que escanean imágenes médicas.